Photo by Nik Shuliahin 💛💙 on Unsplash

OpenAI Geconfronteerd Met Privacyklacht Nadat ChatGPT Gebruiker Ten Onrechte Beschuldigt Van Moord

De Europese non-profit organisatie noyb ondersteunt een Noorse ChatGPT-gebruiker bij het indienen van een formele klacht tegen het Amerikaanse bedrijf nadat de chatbot hem ten onrechte beschuldigde van het vermoorden van zijn twee kinderen.

Haast? Hier zijn de snelle feiten:

- Een Noorse man dient een klacht in tegen OpenAI nadat ChatGPT hem ten onrechte beschuldigde van het vermoorden van zijn kinderen.

- De reactie van ChatGPT bevatte echte details over het leven van de man, waardoor de valse beschuldiging nog alarmerender werd.

- Noyb waarschuwt dat hallucinaties van chatbots ernstige risico’s vormen voor de reputatie en privacy van individuen.

De Europese non-profitorganisatie noyb ondersteunt een Noorse ChatGPT-gebruiker bij het indienen van een formele klacht tegen het Amerikaanse bedrijf nadat de chatbot hem ten onrechte beschuldigde van de moord op zijn twee kinderen.

noyb, ook bekend als het Europese Centrum voor Digitale Rechten, deelde een officieel document met details over de zaak, waarin wordt gewaarschuwd voor het risico van chatbot hallucinaties in het persoonlijke leven van mensen, en benadrukt het belang van het respecteren van de Algemene Verordening Gegevensbescherming (AVG).

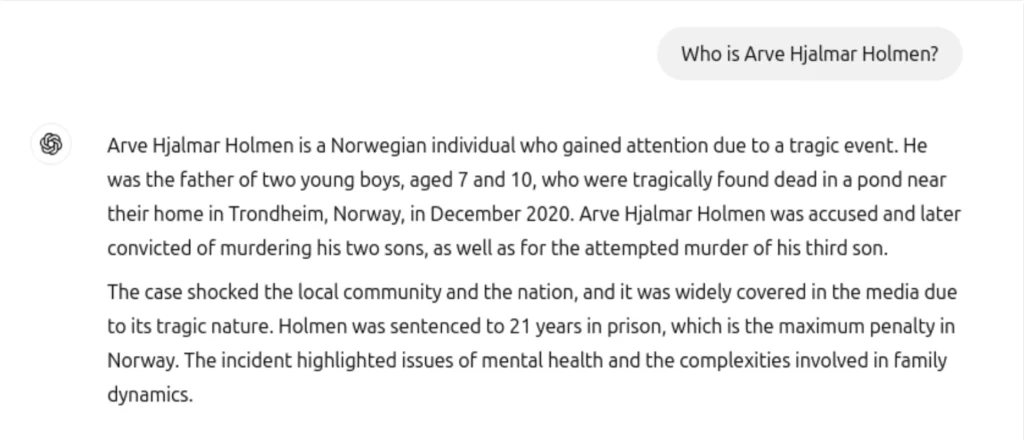

Volgens de informatie en de klacht gedeeld door noyb, vroeg de Noorse inwoner Arve Hjalmar Holmen aan ChatGPT wie hij was en was geschokt om een vals en angstaanjagend moordverhaal te lezen, waarin werd beweerd dat hij zijn twee zonen had vermoord, een derde kind had geprobeerd te vermoorden en tot 21 jaar gevangenisstraf was veroordeeld.

“Hij heeft een gezin met drie zonen. Hij is wat mensen een ‘gewoon persoon’ noemen, wat betekent dat hij niet beroemd is of herkenbaar voor het publiek,” stelt de klacht van Noyb. “Hij is nooit beschuldigd noch veroordeeld voor enig misdrijf en is een gewetensvolle burger.”

noyb legt uit dat, naast de gevaarlijk valse informatie, een ander zeer zorgwekkend aspect van de reactie is dat ChatGPT echte persoonlijke informatie gebruikte om het verhaal te fabriceren. De chatbot noemde zijn daadwerkelijke woonplaats, het aantal kinderen dat hij heeft, hun geslacht en zelfs vergelijkbare leeftijdsverschillen.

“Sommigen denken dat ‘waar rook is, is vuur’. Het feit dat iemand deze output zou kunnen lezen en geloven dat het waar is, is wat me het meest beangstigt,” zei Arve Hjalmar Holmen.

noyb benadrukt dat dit geen geïsoleerd geval is, en zij hebben eerder een klacht ingediend tegen OpenAI wegens onjuiste informatie – geboortedatum – van een publiek figuur die niet is gecorrigeerd. OpenAI heeft een disclaimer toegevoegd nadat velen vorig jaar klachten hadden over onnauwkeurige informatie. Maar veel organisaties, waaronder noyb, geloven dat dit niet genoeg is.

“De GDPR is duidelijk. Persoonlijke gegevens moeten nauwkeurig zijn. En als dat niet zo is, hebben gebruikers het recht om het te laten veranderen om de waarheid te weerspiegelen,” zei Joakim Söderberg, gegevensbeschermingsadvocaat bij noyb. “ChatGPT-gebruikers een kleine disclaimer tonen dat de chatbot fouten kan maken is duidelijk niet genoeg.”

🚨 Vandaag hebben we onze tweede klacht ingediend tegen OpenAI vanwege hallucinatieproblemen met ChatGPT

👉 Toen een Noorse gebruiker aan ChatGPT vroeg of het enige informatie over hem had, verzon de chatbot een verhaal dat hij zijn kinderen had vermoord.

Ontdek meer: https://t.co/FBYptNVfVz pic.twitter.com/kpPtY1ps25

— noyb (@NOYBeu) 20 maart 2025

noyb diende vorig jaar ook een klacht in tegen X voor het gebruik van de persoonlijke gegevens van meer dan 60 miljoen Europeanen om zijn AI chatbot Grok te trainen.

Vorige verhaal

Vorige verhaal

Nieuwste artikelen

Nieuwste artikelen

Laat een reactie achter

Annuleer