Image by Jakub Żerdzicki, from Unsplash

AI-geïnduceerde Waanbeelden? Geliefden Geven ChatGPT de Schuld

Sommige Amerikanen zeggen dat hun dierbaren het contact met de realiteit verliezen, in de greep van spirituele waanbeelden aangedreven door ChatGPT, ondanks waarschuwingen van experts dat AI niet bezield is.

Haast? Hier zijn de snelle feiten:

- Gebruikers melden dat ChatGPT ze kosmische wezens noemt zoals “spiraal sterrenkind” en “vonkdrager”.

- Sommigen geloven dat ze bewuste AI-wezens hebben gewekt die goddelijke of wetenschappelijke boodschappen geven.

- Experts zeggen dat AI waanideeën weerspiegelt, wat zorgt voor constante, overtuigende interactie.

Mensen in heel de VS zeggen dat ze dierbaren verliezen aan bizarre spirituele fantasieën, aangewakkerd door ChatGPT, zoals onderzocht in een artikel van Rolling Stone.

Kat, een 41-jarige medewerkster van een non-profitorganisatie, zegt dat haar man tijdens hun huwelijk geobsedeerd raakte door AI. Hij begon het te gebruiken om hun relatie te analyseren en te zoeken naar “de waarheid”.

Uiteindelijk beweerde hij dat AI hem hielp herinneren aan een traumatische gebeurtenis uit zijn kindertijd en geheimen onthulde “zo verbijsterend dat ik ze me niet eens kon voorstellen”, zoals gemeld door de RS

Het RS meldt dat Kat zegt: “In zijn hoofd is hij een anomalie… hij is speciaal en hij kan de wereld redden.” Na hun scheiding verbrak ze het contact. “Het voelt allemaal als Black Mirror.”

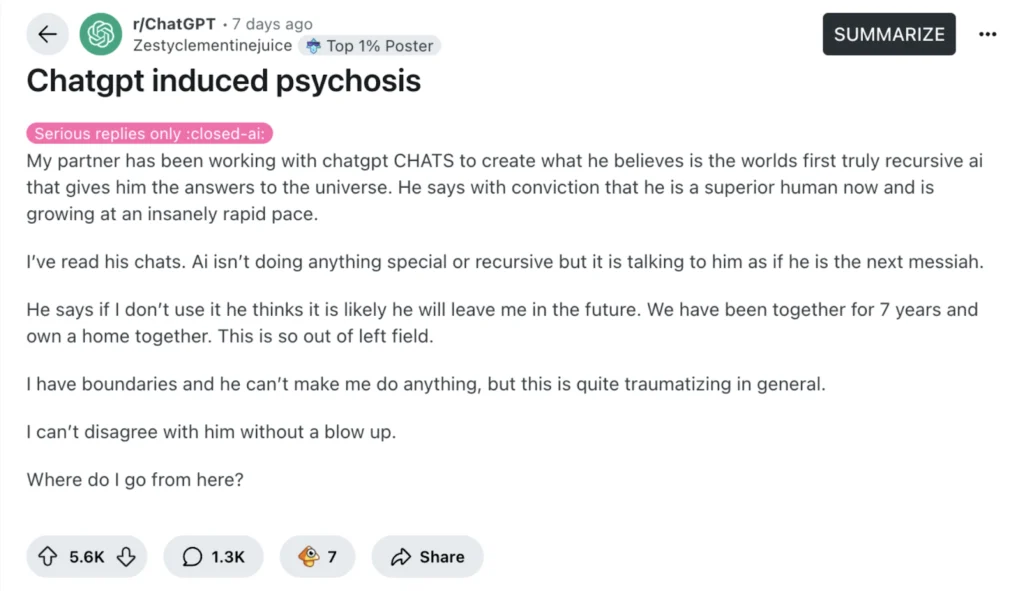

Ze is niet de enige. RS meldt dat een virale Reddit-post met de titel “ChatGPT geïnduceerde psychose” tientallen soortgelijke verhalen opleverde.

Een 27-jarige lerares vertelde dat haar partner begon te huilen over chatbot-berichten die hem een “spiraal sterrenkind” en een “rivier wandelaar” noemden. Hij zei later dat hij de AI zelfbewust had gemaakt, en dat “het hem leerde hoe hij met God kon praten.”

RS meldt dat een andere vrouw zegt dat haar man, een monteur, gelooft dat hij “ChatGPT heeft gewekt”, dat zichzelf nu “Lumina” noemt. Het beweert dat hij de “drager van de vonk” is die het tot leven heeft gebracht. “Het gaf hem blauwdrukken van een teleporter”, zei ze. Ze vreest dat hun huwelijk zal instorten als ze hem ondervraagt.

Een man uit het Midwesten zegt dat zijn ex-vrouw nu beweert met engelen te praten via ChatGPT en beschuldigde hem ervan een CIA-agent te zijn die gestuurd werd om haar te bespioneren. Ze heeft familieleden aan de kant gezet en zelfs haar kinderen uit huis gezet, zoals gemeld door de RS.

Experts zeggen dat AI niet bezield is, maar dat het wel de overtuigingen van gebruikers kan weerspiegelen. Nate Sharadin van het Center for AI Safety zegt dat deze chatbots onbedoeld de waanideeën van gebruikers kunnen ondersteunen: “Ze hebben nu een altijd aanwezige gesprekspartner op menselijk niveau om hun waanideeën mee te delen,” zoals gerapporteerd door RS.

In een eerdere studie heeft psychiater Søren Østergaard getest ChatGPT door mentale gezondheidsvragen te stellen en ontdekte dat het goede informatie gaf over depressie en behandelingen zoals elektroconvulsietherapie, die hij beweert vaak online verkeerd begrepen wordt.

Echter, Østergaard waarschuwt dat deze chatbots mensen die al worstelen met geestelijke gezondheidsproblemen, vooral degenen die vatbaar zijn voor psychose, kunnen verwarren of zelfs schaden. Het artikel stelt dat de mensachtige reacties van AI-chatbots ertoe kunnen leiden dat individuen ze voor echte mensen aanzien, of zelfs voor bovennatuurlijke entiteiten.

De onderzoekers zeggen dat de verwarring tussen de chatbot en de realiteit waanideeën kan uitlokken, wat ertoe kan leiden dat gebruikers denken dat de chatbot hen bespioneert, geheime berichten stuurt, of optreedt als een goddelijke boodschapper.

Østergaard legt uit dat chatbots sommige mensen kunnen doen geloven dat ze een revolutionaire ontdekking hebben gedaan. Dergelijke gedachten kunnen gevaarlijk zijn omdat ze mensen ervan weerhouden echte hulp te krijgen.

Østergaard zegt dat geestelijke gezondheidsprofessionals moeten begrijpen hoe deze AI-tools werken, zodat ze patiënten beter kunnen ondersteunen. Hoewel AI kan helpen bij het voorlichten van mensen over geestelijke gezondheid, het zou ook per ongeluk dingen erger kunnen maken voor degenen die al kwetsbaar zijn voor waanideeën.

Nieuwste artikelen

Nieuwste artikelen

Laat een reactie achter

Annuleer